MI-AI

GEMINI

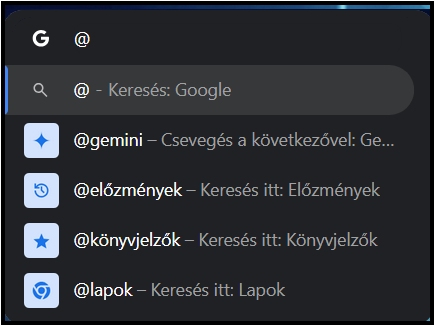

Chrome böngésző címsorába írd be: @

A legördülő menüből válaszd

a @gemini-t,

a | promt

után írd be a kérdésed + Enter.

Várj! (1-2 sec)

Sider bővítmény:

Válaszd a Chrome böngésződben bővítmény kezelőt, abból a Chrome áruházat. Keresd meg Sider Fusion-t, vagy Chat GTP-t. Telepítsd! (Akár mindkettőt is)

Új: Mistral AI

A "mistral" szó erős, hideg szeleket jelent, amely a Rhône-völgyből fúj a Nyugati-Alpok irányába, Franciaország déli részén, különösen a Provence régióban. Ez a szél főként télen és tavasszal jellemző, és jelentős hatással van az időjárásra. Valószínűleg a szél jelenős hatása miatt választották a francia mesterséges intelligencia nevének, hiszen ami az időjárst ismeg tudja váloztatni az nagyon erős lehet

Ebben is célszerű a google fiókoddal bejelentkezni

Fotó háttér cserélő intelligencia

Napi limit van, de úgysem fogsz tömeggyártásba (szerintem)

Mást is tud:eltávolítja a hátteret, kicserél tárgyakat másra, eltávolít a képről kijelölt dolgokat, a feltöltött képről eltávolítja a szövegeket , feliratokat. Néha várni kell a szerverre, hogy elvégezze a kért műveleteket

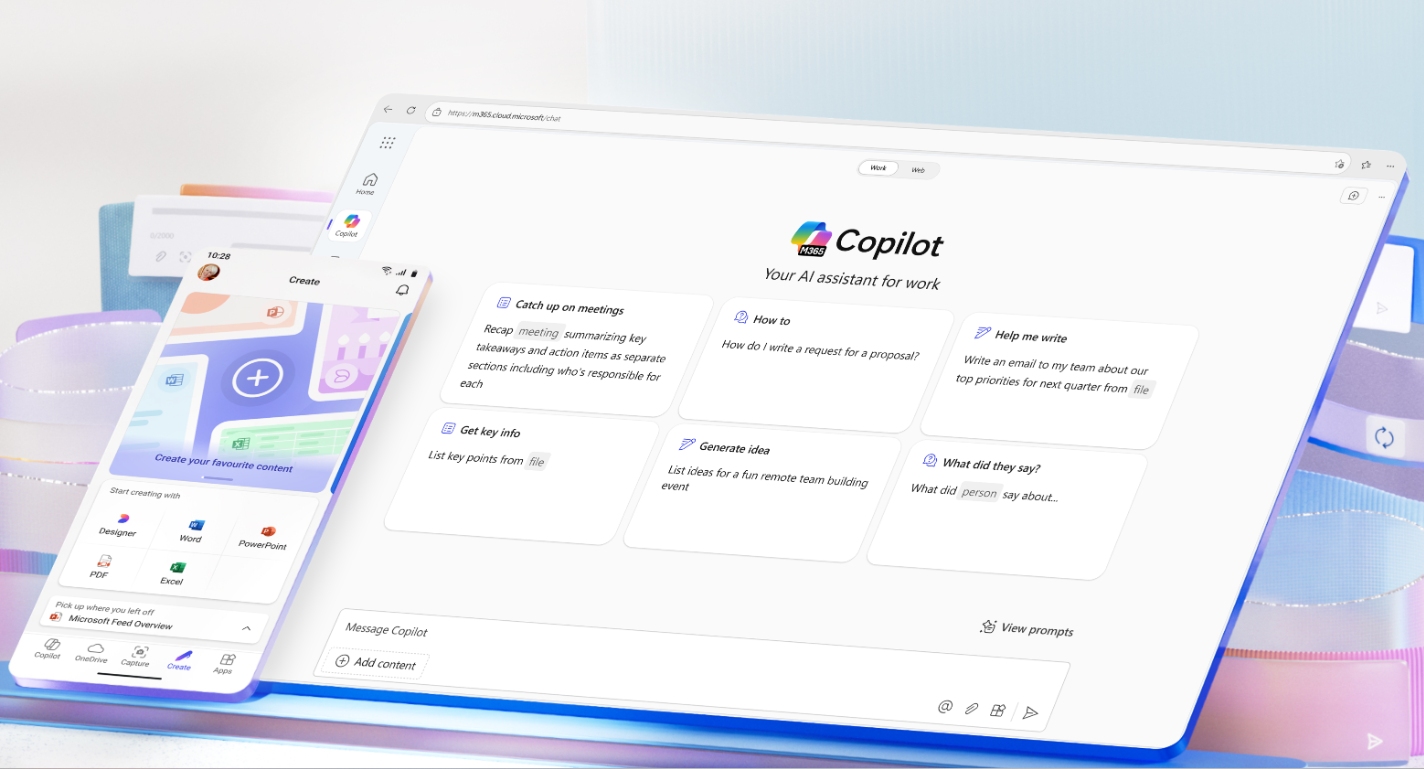

Copilot

Amennyiben bejelentkezel az iskolai Office 365 fiókodba ( A neve már Microsoft365) , akkor ott eléred a Copilot segítségét.

Ha végeztél, akkor ne felejts el mindig kijelentkezni a tantermi gépedről!

Helló, figyelsz! Miért fontos ez?

A mesterséges intelligencia (MI) használatának több veszélye is van, amelyeket fontos figyelembe venni:

Társadalmi elfogultság: Az MI rendszerek az adatok hibáit tükrözhetik, ami diszkriminációhoz vagy igazságtalansághoz vezethet bizonyos csoportokkal szemben.

Adatvédelem: Az érzékeny adatok kezelése során fennáll a veszélye, hogy azok kiszivárognak vagy rosszul használják fel őket.

Munkanélküliség: Az automatizáció műszaki fejlődése munkahelyek elvesztését idézheti elő, különösen az alacsonyabb képzettségű pozíciókban.

Etikai dilemmák: Az MI döntési folyamatainak átláthatósága és etikai alapja kérdésessé válhat, különösen érzékeny területeken, mint például az egészségügyi vagy rendvédelmi alkalmazások.

Kiberbiztonsági kockázatok: Az MI rendszerek sebezhetők lehetnek a hackelésre és a manipulációra, ami veszélyeztetheti a rendszerek integritását.

Hamis információk terjedése: Az MI képes hamis tartalom létrehozására, ami hozzájárulhat a dezinformáció terjedéséhez.

Felelősség hiánya: Nehezen meghatározható, ki vállalja a felelősséget, ha az MI rendszerek hibás döntéseket hoznak.

Ezek a veszélyek komoly odafigyelést és etikus megközelítést igényelnek az MI alkalmazása során.

Az AI etikus használatához a következő alapelveket érdemes figyelembe venni:

- Átláthatóság: Legyen világos, hogy AI-t használsz, és hogyan működik az algoritmus.

- Adatvédelem: Tartsd tiszteletben a felhasználók adatainak védelmét, és biztosítsd az adatok biztonságos kezelését.

- Igazságosság: Kerüld a diszkriminatív döntéseket, és biztosítsd, hogy az AI rendszerek igazságosan kezeljék a felhasználókat.

- Felelősség: Legyen világos, ki felelős az AI döntéseiért és cselekedeteiért.

- Felhasználói tájékoztatás: Tájékoztasd a felhasználókat az AI által végzett tevékenységekről, és adj nekik lehetőséget a döntéseik befolyásolására.